「12.AIを社内に導入するとは?」で説明したように

AIの言語中枢の部分(=推論サーバー)だけを

AIゲートウェイとしてIBM iのPASE環境に導入すれば

クラウドAIのみの場合にクラウドAIに参考ソース・コードを

貼り付けて渡す必要はなくなる。

Copilitのように渡すクリッブ・ボードの長さの制限もない。

AIゲートウェイをIBM iのPASE環境に導入すると

PASE環境からIFSやDB2データ・ベースを読んだり

更新したりすることもできる。

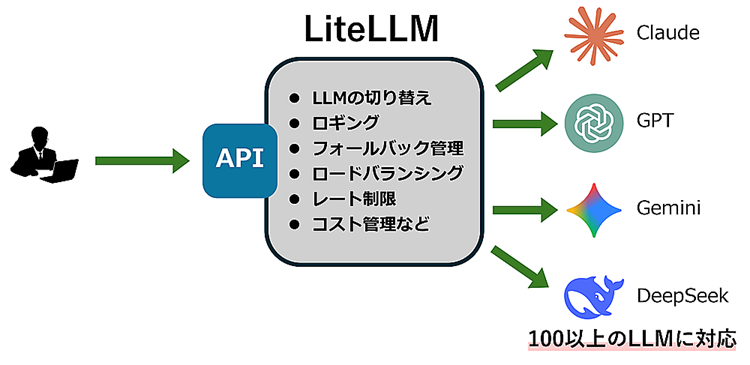

特にLiteLLMというAIゲートウェイはPythonで書かれていて

LineLLMをライブラリーとしてユーザーの書くPythonプログラムから

呼出して100以上あるクラウドのAIモデルと会話することが

できるようになる。

LiteLLM の実行環境としては IBM iのPASE環境にPython3.8以上が

導入されていることが必要である。

Python.400を開発した㈱オフィスクアトロでは

既存の技術でPython3.8の導入やLineLLMの利用も可能である。

つまりIBM iからChatGPT, Copilot や Google Gemini, Claudeなどの

世界中のAIモデルと会話して使うことができるようになる。

IBMユーザーでもPythonをIBM i上で動作させたことのある経験者であれば

・Python.3.8の導入

・LineLLM の導入

のふたつの敷居をこなせば実現できるはずである。

実は(株)オフィスクアトロではこの原稿を書いているころには

・OS Ver7.3 に Python.3.9 を導入

・同じOS Ver7.3 に LiteLLM を導入

を実行した。

これでLiteLLMを使えば世界中のAIモデルと会話できるはずであった。

しかし LiteLLMの導入では Rustという言語で書かれたプログラムの

コンパイルが必要になるが IBM PASE環境はまちろん IBM AIXにも

Rust Compliler は提供されていなかったので LiteLLMは全体を

導入できない。

■ LiteLLM のサブセットを導入

AIに相談した結果、LiteLLMの全体を導入するのではなく

pip LiteLLM —

としてLiteLLMのサブセットを導入するように指示することによって

Rust Compiler を必要としなくて済むようになったので

LiteLLMを無事導入することができるようになった。

■ 実行してみると

ところが実行してみるとサブセットを導入したので実行してみると

次から次へと必要なモジュールが見つからないというエラーに見舞われた。

そこでAIはそのようなモジュールを必要としない古いリリースの

LiteLLMを導入するように勧めてきした。

このようにLiteLLMの導入と実行はAiと協議や相談をしながら

進めていく仕事になった。

とうとう最後にAIは「IBM iでLiteLLMを導入して使うのは不可能です」

とサジを投げてしまった。

これでわかるようにAIは何もいつもすべて正しいことだけを

言っているのではなく推論や過ちの発言はいくらでもある。

…これで(株)オフィスクアトロはIBM i上から世界中のAIモデルと

会話するという夢のような目的をあきらめることになるのだろうか?

この続きは次回の投稿で。